Google hat still und leise zurückgekämpft – und Gemini 3.1 Pro dominiert jetzt 12 von 18 Benchmarks.

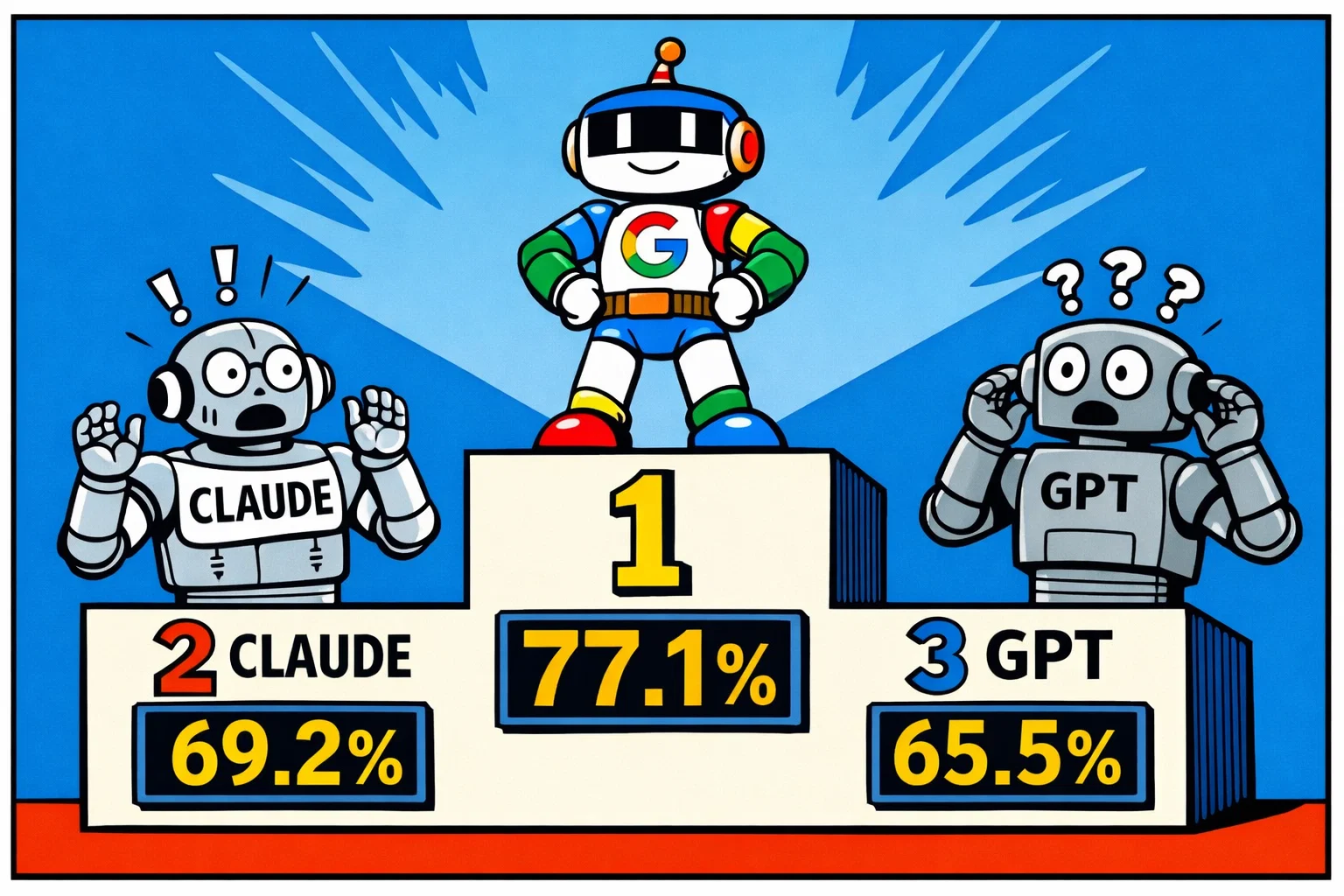

Am 19. Februar 2026 hat Google DeepMind Gemini 3.1 Pro released. Kein riesiger Launch-Event, kein Hype-Countdown. Einfach draußen. Und die Zahlen sprechen für sich: Auf dem ARC-AGI-2-Benchmark – dem härtesten Test für echtes logisches Schlussfolgern mit völlig neuen Problemtypen – erreicht Gemini 3.1 Pro 77,1%. Claude Opus 4.6 kommt auf 68,8%, GPT-5.2 auf 52,9%.

Das ist mehr als eine Verbesserung. Das ist ein Generationensprung zum Vorgänger: Gemini 3 Pro kam auf 31,1% auf demselben Benchmark. Mehr als doppelt so gut, in einem Release-Zyklus.

Was die Zahlen wirklich sagen: Gemini 3.1 Pro führt auf 12 von 18 getesteten Benchmarks – darunter GPQA Diamond (Expertenfragen auf Doktoranden-Niveau) mit 94,3% und MCP Atlas für Tool-Koordination mit 69,2%. Claude Opus 4.6 verteidigt dagegen seinen Spitzenplatz auf SWE-Bench Verified (80,8% vs 80,6%) und bei komplexen Büroaufgaben. GPT-5.2 bleibt hinter beiden zurück.

Drei Dinge die wirklich neu sind: Erstens, der 1 Million Token-Kontext – Gemini verarbeitet jetzt ganze Codebases, lange Rechtsdokumente oder mehrstündige Transkripte in einem Rutsch. Zweitens: natives SVG-Rendering – das Modell kann Vektorgrafiken direkt erzeugen und verstehen. Drittens: Google hat den Preis nicht erhöht, obwohl die Leistung massiv gestiegen ist.

Was fehlt? Laut unabhängigen Tests hat Gemini 3.1 Pro ein Reasoning-Gedächtnisproblem: Bei sehr langen Reasoning-Chains verliert das Modell frühe Kontextelemente. Für komplexe Multi-Step-Aufgaben, die über Stunden laufen, ist Claude Opus 4.6 aktuell robuster. Dieser Punkt fehlt in Googles offizieller Benchmarkpräsentation – und das ist bezeichnend.

Die Community-Reaktion auf HackerNews ist gespalten: Begeisterung für ARC-AGI-2 und die 1M-Token-Leistung, Skepsis gegenüber den "13 von 16 Wins"-Headlines, weil die Benchmark-Auswahl stark von Google selbst kuratiert wirkt.

Google ist zurück. Ob es der klare Marktführer ist, entscheidet sich in den nächsten Wochen – wenn DeepSeek V4 kommt.