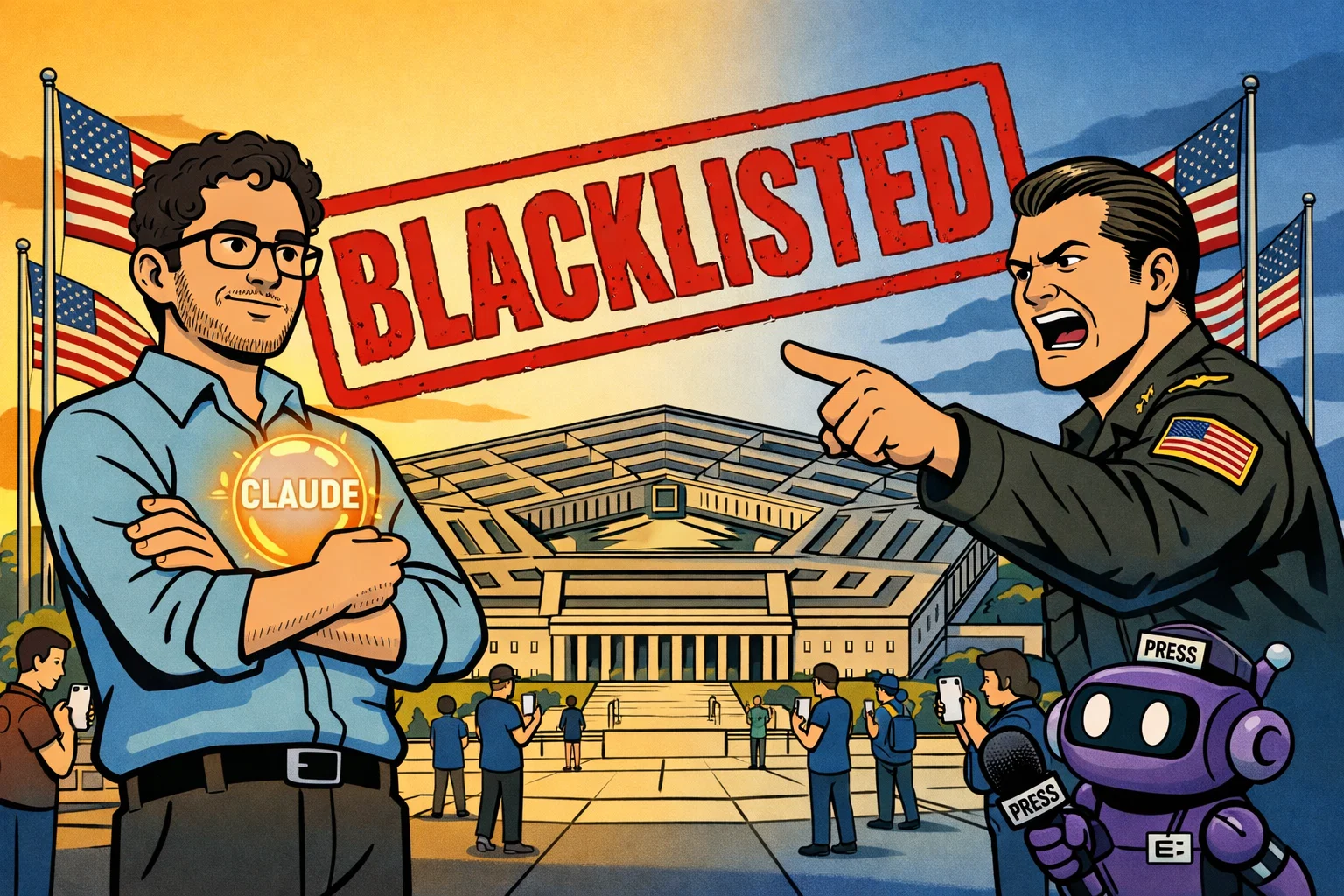

Das Pentagon hat Anthropic zur "Supply Chain Risk" erklärt – weil Dario Amodei sich geweigert hat, KI-Sicherheitsgrenzen für Killerroboter aufzuheben.

Die Geschichte ist schnell erzählt: Das US-Verteidigungsministerium wollte Claude ohne Einschränkungen nutzen – inklusive vollautonomer Waffensysteme, die ohne menschliche Genehmigung töten können, und Massenüberwachung amerikanischer Bürger. Anthropic-CEO Dario Amodei hat Nein gesagt. Trump und Verteidigungsminister Pete Hegseth haben daraufhin Anthropic auf die schwarze Liste gesetzt. Der Pentagon-Vertrag – mit einem Volumen von bis zu 200 Millionen Dollar – wird innerhalb von sechs Monaten abgewickelt.

Das ist politisch und wirtschaftlich schmerzhaft. Aber die Reaktion der Öffentlichkeit war anders als erwartet.

Kein Rückzug, sondern Reputationsgewinn

In den 48 Stunden nach der Blacklist-Bekanntmachung schoss Claude auf Platz 1 der kostenlosen Apps im Apple App Store – und verdrängte damit ChatGPT. Anthropic musste wegen der Nachfrage sogar kurzzeitig erhöhte Fehlerquoten melden. Der Markt hat offenbar honoriert, was das Unternehmen getan hat.

Amodei selbst sagte, die beiden abgelehnten Nutzungsarten – autonome Waffensysteme und Massenüberwachung – "waren nie Teil unserer Verträge mit dem Verteidigungsministerium, und wir glauben, dass sie es auch nicht sein sollten." Pentagon-Verhandlungsführer Emil Michael nannte Amodei daraufhin einen "Lügner mit Gotteskomplex". Das Niveau der Auseinandersetzung sagt viel über den Druck aus, unter dem Anthropic stand.

Was "Supply Chain Risk" konkret bedeutet

Die Bezeichnung ist schärfer als sie klingt. Defense-Contractor müssen künftig zertifizieren, dass Claude in keinem ihrer Workflows vorkommt. Lockheed Martin, Palantir und andere haben bereits angefangen, ihre Systeme umzustellen. xAI und OpenAI haben die Lücke sofort gefüllt: xAI unterschrieb einen Deal für Grok in klassifizierten Militärsystemen, OpenAI übernahm einen Teil der bisherigen Anthropic-Infrastruktur beim Pentagon.

Der Haken: Selbst Pentagon-interne Stimmen räumen ein, dass das Ersetzen von Claude "ein sehr schwieriger Prozess" sein wird. Und die New York Times zitiert Verteidigungsbeamte mit der Einschätzung, das xAI-Modell sei "nicht so fortschrittlich oder zuverlässig" wie Anthropic's Claude. Das Pentagon tauscht also ein besseres Modell gegen ein schlechteres – aus politischen Gründen.

Anthropic klagt

Das Unternehmen fechtet die Designierung gerichtlich an. Laut Lawfaremedia.org hat das Pentagon juristisch fragwürdiges Terrain betreten: Hegseth fehlt möglicherweise die gesetzliche Grundlage, um Firmen, die mit Anthropic zusammenarbeiten, aus Regierungsaufträgen auszuschließen. Ob das Gericht dieser Einschätzung folgt, bleibt offen.

Was das für die KI-Branche bedeutet

Der Fall setzt einen Präzedenzfall: Wer Safety-Grenzen zieht, riskiert Ausgrenzung aus dem größten Auftraggeber der Welt. Wer keine Grenzen zieht, bekommt den Vertrag – und die Verantwortung. OpenAI und xAI haben sich bewusst für Option zwei entschieden. Ob das eine gute Entscheidung ist, wird sich zeigen – im schlimmsten Fall nicht in einem Gerichtssaal, sondern auf einem Schlachtfeld.

Dass Claude trotzdem Platz 1 im App Store geholt hat, zeigt: Prinzipien können auch ein Geschäftsmodell sein.