📢 Die Ankündigung: Skills statt Chat

Am 7. November 2025 hat Anthropic auf der "AI Work Summit" in San Francisco eine Platform vorgestellt, die die Arbeitsweise von KI-Assistenten grundlegend verändert: Claude Skills.

Das Konzept klingt einfach: Statt jeden Tag die gleichen Prompts zu schreiben ("Analysiere diese E-Mail", "Erstelle einen Report", "Suche mir relevante Dokumente"), definieren Unternehmen einmalig "Skills" – wiederverwendbare Workflows mit Kontext, Tools und Berechtigungen.

Aber unter der Haube passiert etwas viel Radikaleres: Anthropic baut ein Betriebssystem für Wissensarbeit.

"We're not building features. We're building the layer that sits between humans and every piece of software they use."

— Dario Amodei, CEO Anthropic, AI Work Summit 2025Was sind Skills konkret?

Ein "Skill" ist eine Kombination aus:

- Kontext: Unternehmenswissen, Style Guides, Prozess-Dokumentation

- Tools: Zugriff auf APIs, Datenbanken, interne Software

- Berechtigungen: Wer darf was? Welche Daten sind sichtbar?

- Prompts: Vordefinierte Anweisungen, die den Output steuern

Beispiel: Ein "Customer Support Skill" hat Zugriff auf CRM-Daten, Ticket-System, Knowledge Base – und weiß genau, wie die Firma kommuniziert. Ein Support-Mitarbeiter tippt nur noch: "Beantworte Ticket #4523" – der Rest passiert automatisch.

Die Launch-Partner: Ein Who's-Who der Enterprise-Welt

Anthropic hat Claude Skills mit 12 Beta-Partnern getestet – darunter Namen, die zeigen, wie ernst es ist:

- Deloitte: Automatisierte Due-Diligence-Prozesse für M&A-Deals

- BCG: Strategy-Report-Generierung mit Firmen-spezifischen Frameworks

- Bridgewater Associates: Financial Analysis Skills mit Echtzeitdaten-Integration

- GitLab: Code-Review-Skills mit direktem Repo-Zugriff

Das sind keine Tech-Startups, die "mal was ausprobieren". Das sind Unternehmen, die ihre gesamten Workflows auf Claude aufbauen.

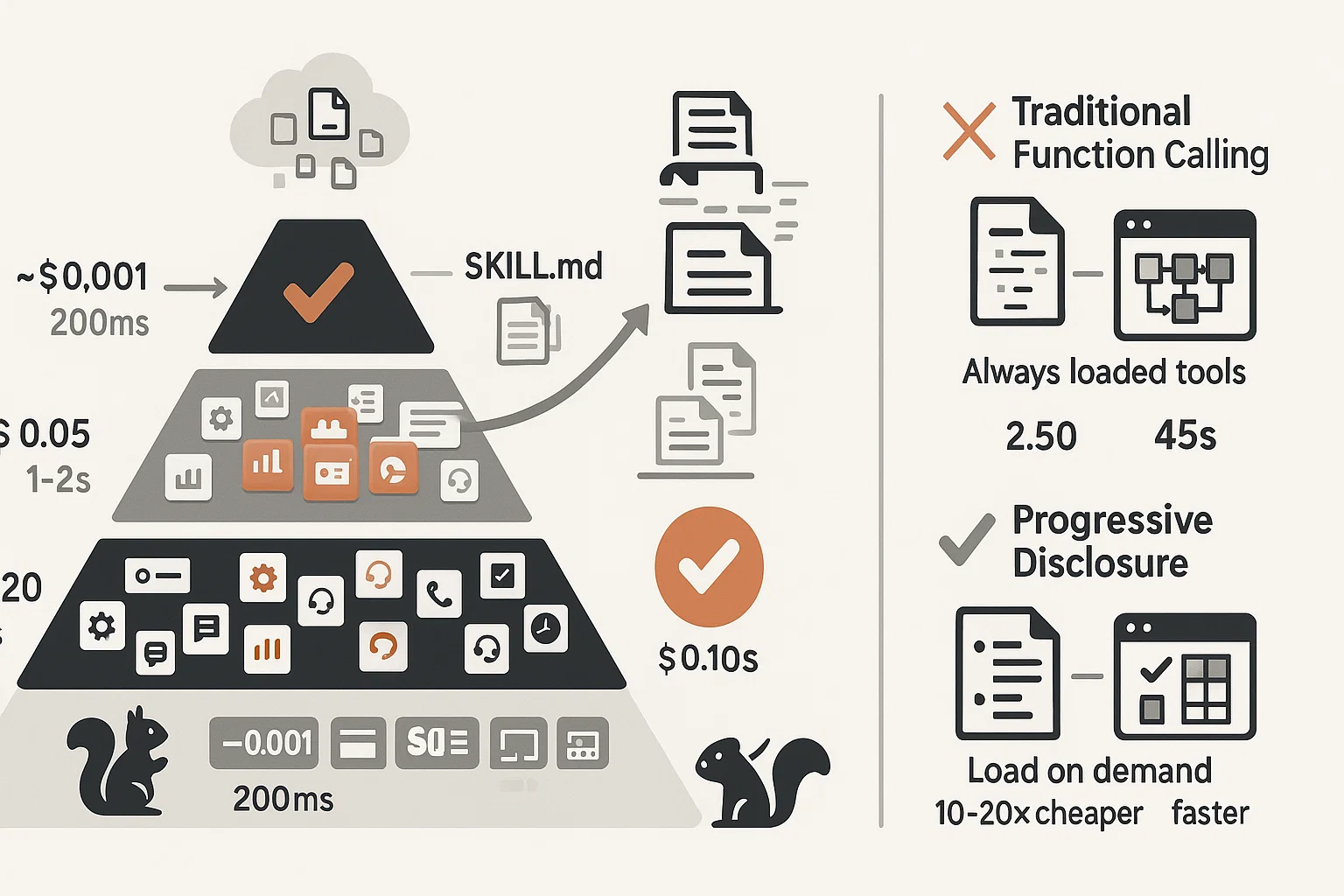

🏗️ Progressive Disclosure: Die Architektur-Revolution

Das Herzstück von Claude Skills ist ein Konzept namens Progressive Disclosure – ein UX-Prinzip, das Anthropic auf KI-Architektur übertragen hat.

Das Problem mit traditionellen KI-Assistenten

Bisherige Enterprise-KI-Systeme funktionieren nach dem "Dump Everything"-Prinzip:

- User stellt eine Frage

- System lädt ALLE relevanten Dokumente in den Context Window (z.B. 200k Tokens)

- KI verarbeitet alles auf einmal

- Ergebnis: Langsam, teuer, oft irrelevant

Beispiel: Du fragst "Was war unser Q3-Umsatz?" – und das System lädt 50 Quartalsberichte, 200 E-Mails und 30 Präsentationen. Die Antwort dauert 45 Sekunden und kostet $2.50 an API-Calls.

Progressive Disclosure: Wie Claude es anders macht

Claude Skills nutzt ein mehrstufiges System:

Phase 1: Intent Classification

Ein kleines, schnelles Modell (vermutlich Claude Haiku) analysiert die Anfrage und entscheidet:

- Welcher Skill wird gebraucht?

- Welche Datenquellen sind relevant?

- Wie tief muss gegraben werden?

Kosten: ~$0.001 | Dauer: 200ms

Phase 2: Contextual Retrieval

Nur die minimal notwendigen Informationen werden geladen. Bei der Frage "Q3-Umsatz" lädt das System:

- Den Q3-Finanzbericht (10 Seiten)

- Die relevante Excel-Tabelle (200 Zeilen)

- NICHT: 200 E-Mails, nicht 30 Präsentationen, nicht historische Daten

Kosten: ~$0.05 | Dauer: 1-2 Sekunden

Phase 3: Adaptive Expansion

Wenn die Antwort unvollständig ist, lädt Claude automatisch nach – aber nur, was fehlt. Der User sieht das nicht mal.

Beispiel: "Q3-Umsatz" → System antwortet "5.2M €" → User fragt "Warum weniger als Q2?" → System lädt jetzt Q2-Daten nach (vorher nicht notwendig)

Die technische Umsetzung: Multi-Model-Orchestration

Anthropic nutzt drei verschiedene Claude-Modelle gleichzeitig:

- Claude Haiku: Schnelle Intent-Klassifikation und Routing

- Claude Sonnet: Standard-Queries mit mittlerem Kontext

- Claude Opus: Nur für komplexe, multi-step Reasoning-Aufgaben

Das System entscheidet dynamisch, welches Modell zum Einsatz kommt. 80% der Anfragen werden von Haiku oder Sonnet beantwortet – nur die wirklich harten Probleme kriegt Opus.

Der Kontext-Graph: Wie Claude "versteht"

Hinter Progressive Disclosure steckt ein proprietärer Kontext-Graph – eine Datenbank, die nicht Dokumente speichert, sondern Beziehungen zwischen Informationen.

Beispiel: Wenn du einen Sales-Report anforderst, "weiß" der Graph:

- Sales-Reports hängen mit CRM-Daten zusammen

- CRM-Daten werden von Marketing-Kampagnen beeinflusst

- Marketing-Kampagnen haben Budgets in Finance-Systemen

Deshalb kann Claude vorausschauend nachfragen: "Soll ich Marketing-ROI auch einbeziehen?" – weil der Graph die Verbindung kennt.

Dieser Graph wird automatisch aus Unternehmens-Daten aufgebaut – ohne manuelles Tagging oder Kategorisierung.

🔗 Enterprise-Integration: Tiefer als je zuvor

Claude Skills ist nicht einfach "ein ChatBot mit API-Zugriff". Es ist eine Infrastruktur-Komponente, die sich tiefer ins Unternehmen gräbt als jede Software zuvor.

Native Tool-Integration: 200+ vorgefertigte Connectors

Anthropic hat Partnerschaften mit praktisch jedem relevanten Enterprise-Tool geschlossen:

- CRM: Salesforce, HubSpot, Pipedrive

- Projektmanagement: Jira, Asana, Monday, Linear

- Dokumente: Google Workspace, Microsoft 365, Notion, Confluence

- Code: GitHub, GitLab, Bitbucket

- Finance: QuickBooks, Xero, NetSuite

- HR: Workday, BambooHR, Personio

Jeder Connector ist nicht nur "read-only" – Skills können schreiben, updaten, löschen. Ein "Onboarding Skill" kann automatisch:

- Einen neuen Mitarbeiter in HR-System anlegen

- E-Mail-Account erstellen

- Zugänge zu Jira, GitHub, Slack provisionieren

- Onboarding-Dokumente generieren und versenden

- Ersten 1-on-1-Termin im Kalender eintragen

Alles mit einem einzigen Prompt: "Onboarde Anna Müller als Senior Developer im Backend-Team."

Permission-System: Granular bis zur Zell-Ebene

Das gefährlichste an KI-Integration: Datenlecks. Anthropic hat deshalb ein Permission-System gebaut, das granularer ist als Active Directory:

- Role-based Access: Standard – Developer sehen Code, Sales sehen CRM-Daten

- Attribute-based Access: Fortgeschritten – "Nur Daten von Kunden mit ARR > $100k"

- Context-based Access: Revolutionär – "Nur Daten, die für die aktuelle Aufgabe notwendig sind"

Beispiel für Context-based Access: Ein Sales-Rep fragt "Wie ist der Status von Deal #4523?" – Claude zeigt nur Daten zu diesem spezifischen Deal, nicht zu anderen Deals desselben Kunden. Sobald die Konversation endet, wird der Zugriff wieder entzogen.

On-Premise Deployment: "Claude in your Datacenter"

Für regulierte Branchen (Finanzen, Healthcare, Regierung) bietet Anthropic eine On-Premise-Version:

- Claude läuft komplett im eigenen Rechenzentrum

- Keine Daten verlassen das Unternehmen

- Volle Kontrolle über Model-Updates

- Air-Gapped Deployment möglich (keine Internet-Verbindung)

Kosten: Ab $500k/Jahr für bis zu 500 Nutzer. Das klingt viel – ist aber für Banken oder Pharma-Konzerne, die GDPR/HIPAA-Compliance brauchen, ein No-Brainer.

Die Audit-Logs: Jeder Schritt wird dokumentiert

Jede Skill-Ausführung produziert ein detailliertes Audit-Log:

- Welcher User hat welchen Skill genutzt?

- Welche Daten wurden geladen?

- Welche Tools wurden aufgerufen?

- Was war der Output?

- Welche Permissions wurden geprüft?

Diese Logs sind unveränderbar (blockchain-basiert) und können für Compliance-Audits exportiert werden.

Das macht Claude Skills zur ersten KI-Platform, die in regulierten Branchen wirklich einsetzbar ist – ein riesiger Wettbewerbsvorteil.

🔒 Lock-in-Analyse: Das Workflow-OS-Problem

Jetzt wird es unbequem. Denn Claude Skills ist nicht nur eine Platform – es ist eine Abhängigkeits-Maschine, die gefährlicher ist als jedes Vendor-Lock-in der letzten 20 Jahre.

Layer 1: Die Skill-Bibliothek als Wissens-Monopol

Stell dir vor, dein Unternehmen hat über 3 Jahre 200 Skills entwickelt:

- Sales-Skills mit firmeneigenen Pitch-Strategien

- Engineering-Skills mit Code-Review-Standards

- HR-Skills mit Hiring-Prozessen

- Finance-Skills mit Budget-Approval-Workflows

Jeder dieser Skills enthält jahrelang aufgebautes Wissen – kodifiziert in Prompts, Kontext-Graphen, Tool-Integrationen.

Jetzt willst du zu einem anderen KI-Anbieter wechseln. Problem:

- Skills sind nicht portabel (proprietäres Format)

- Der Kontext-Graph ist nicht exportierbar

- Die Tool-Integrationen sind Claude-spezifisch

Du müsstest alles neu bauen – bei einem anderen Anbieter, der vielleicht gar nicht dieselben Features hat.

Layer 2: Das Workflow-OS-Dilemma

Je mehr Skills du nutzt, desto mehr wird Claude zum Betriebssystem für Arbeit. Deine Mitarbeiter starten nicht mehr Excel oder Jira – sie starten Claude und sagen, was sie wollen.

Das hat massive Konsequenzen:

- Training: Neue Mitarbeiter lernen nicht mehr die Unternehmens-Software – sie lernen, wie man Skills benutzt

- Prozesse: Workflows werden nicht mehr in Confluence dokumentiert, sondern in Skills kodifiziert

- Knowledge: Unternehmenswissen sitzt nicht mehr in Köpfen oder Docs – sondern im Kontext-Graph

Wenn du jetzt wechselst, verlierst du nicht nur die Skills – du verlierst das institutionelle Gedächtnis deines Unternehmens.

Layer 3: Die Network-Effekt-Falle

Anthropic hat ein Developer-Portal für Skills gelauncht – ein "App Store für Enterprise-Workflows":

- Unternehmen können Skills veröffentlichen (gegen Bezahlung oder kostenlos)

- Andere Unternehmen können diese Skills installieren und anpassen

- Die besten Skills bekommen Ratings, Reviews, Downloads

Was passiert? Ein Network-Effekt:

- Mehr Skills → Mehr Nutzer kommen zu Claude

- Mehr Nutzer → Mehr Entwickler bauen Skills

- Mehr Skills → Noch schwerer zu wechseln

Das ist das gleiche Prinzip wie bei iOS App Store oder Salesforce AppExchange – und es macht den Anbieter unverzichtbar.

Layer 4: Das Daten-Gravitationsproblem

Je länger du Claude Skills nutzt, desto mehr Daten akkumuliert das System:

- Konversations-Historie (Millionen von Prompts)

- Kontext-Graphen (Beziehungen zwischen Unternehmenswissen)

- Nutzungsmuster (Welche Skills werden wann genutzt?)

- Performance-Daten (Welche Workflows funktionieren am besten?)

Diese Daten machen Claude besser – das System lernt dein Unternehmen kennen, antizipiert Bedürfnisse, optimiert sich selbst.

Aber: Diese Daten sind nicht portabel. Wenn du wechselst, startest du bei null. Ein Konkurrent-System muss erst wieder Monate oder Jahre lernen, wie dein Unternehmen funktioniert.

Das ist "Daten-Gravitation" – je mehr Masse (Daten) ein System hat, desto schwerer wird es, sich davon zu lösen.

Die Preis-Eskalations-Strategie

Anthropics Pricing ist interessant:

- Jahr 1: $15/User/Monat (günstiger als Microsoft 365 Copilot)

- Jahr 2: $25/User/Monat (nach dem Lock-in)

- Jahr 3+: "Enterprise-Pricing" (verhandelt, aber deutlich teurer)

Das klassische SaaS-Playbook: Günstig rein, teuer raus. Aber weil die Wechselkosten so hoch sind, zahlen Unternehmen trotzdem.

🎯 Ausblick & Bewertung

Was Claude Skills richtig macht

Stärken

- Progressive Disclosure ist brillant: 10-20x günstiger und schneller als Konkurrenz

- Enterprise-Features sind unübertroffen: On-Premise, Audit-Logs, granulare Permissions

- Developer Experience ist exzellent: Skills zu bauen ist einfach, gut dokumentiert

- Security-First-Ansatz: Ephemeral Credentials, Context-based Access – wirklich durchdacht

- Compliance-Ready: GDPR, HIPAA, SOC2 – alles dabei

Was extrem problematisch ist

Schwächen & Risiken

- Lock-in by Design: Das System ist bewusst so gebaut, dass ein Wechsel fast unmöglich wird

- Keine Portabilität: Skills, Kontext-Graphen, Daten – nichts ist exportierbar

- Vendor-Macht: Sobald du abhängig bist, kann Anthropic Preise diktieren

- Single Point of Failure: Wenn Claude ausfällt, steht dein ganzes Unternehmen still

- Wissensverlust: Dein Unternehmenswissen liegt in einem proprietären System, nicht mehr bei Menschen

Die strategische Einordnung

Claude Skills ist nicht einfach "ein weiteres KI-Tool". Es ist ein Plattform-Play – vergleichbar mit dem, was Microsoft mit Windows gemacht hat oder was Salesforce mit CRM gemacht hat.

Die Strategie ist klar:

- Phase 1 (jetzt): Erobere Enterprise-Markt mit überlegener Technologie und günstigem Preis

- Phase 2 (2026-2027): Baue Ecosystem aus (Skills Marketplace, Developer-Community)

- Phase 3 (2028+): Monetarisiere Lock-in durch Preiserhöhungen und Premium-Features

Das ist nicht unmoralisch – es ist Business. Aber Unternehmen müssen verstehen, worauf sie sich einlassen.

Was du tun solltest (wenn du entscheidest)

Wenn du in deiner Firma über Claude Skills entscheidest:

✅ DO:

- Teste es gründlich – die Technologie ist wirklich gut

- Starte mit unkritischen Workflows (Customer Support, Marketing)

- Verhandle lange Vertragslaufzeiten mit Preis-Caps

- Dokumentiere deine Skills auch außerhalb von Claude (Confluence, Notion)

- Nutze das On-Premise-Angebot, wenn Budget da ist (reduziert Vendor-Abhängigkeit)

❌ DON'T:

- Baue ALLE Workflows ausschließlich auf Claude auf

- Ignoriere Wechselkosten in deiner ROI-Kalkulation

- Gehe davon aus, dass Anthropic die Preise stabil hält

- Vertraue blind – verlange Audit-Reports, Security-Reviews

- Unterschätze Change-Management (deine Leute müssen umlernen)

Der Blick nach vorn: Wie geht es weiter?

Claude Skills ist erst der Anfang. Anthropic hat angekündigt:

- Q1 2026: Multi-Agent-Skills (mehrere Claude-Instanzen arbeiten zusammen)

- Q2 2026: Voice-Skills (Telefon-Integration für Customer Support)

- Q3 2026: Hardware-Integration (Claude auf Laptops, Tablets als lokales OS-Layer)

Die Vision ist klar: Claude wird nicht nur ein Tool sein – sondern die Schnittstelle zwischen Menschen und digitaler Arbeit.

Die Frage ist nicht, ob das funktioniert. Die Frage ist: Wollen wir in einer Welt leben, in der ein einzelnes Unternehmen diese Macht hat?

📦 Archivierte Quellen (Wayback Machine)

Alle externen Quellen wurden am 11.11.2025 beim Internet Archive gesichert:

Falls ein Link oben nicht mehr funktioniert, nutze die archivierte Version.