💰 Die Allianz: Microsoft, Nvidia & Anthropic

Die Zahlen sind gigantisch: Nvidia investiert bis zu 10 Milliarden Dollar, Microsoft steuert 5 Milliarden bei. Im Gegenzug verpflichtet sich Anthropic, Cloud-Rechenleistung im Wert von 30 Milliarden Dollar von Microsoft Azure zu kaufen und Nvidias neueste Chips (Grace Blackwell und Vera Rubin) zu nutzen.

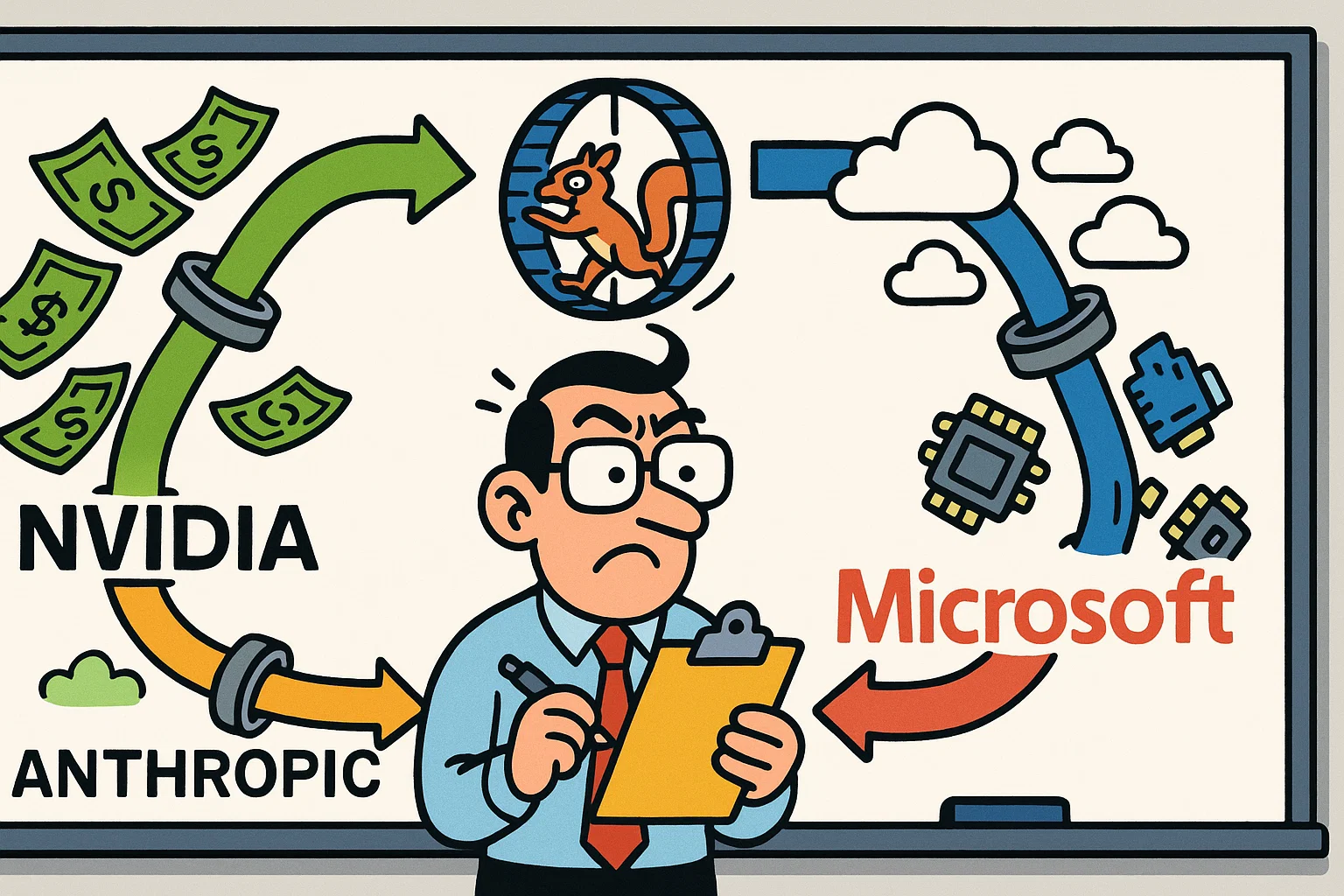

🔄 Zirkuläre Finanzierung: Ein riskantes Spiel?

Analysten sprechen von "Circular Financing". Das Geld fließt im Kreis:

- Nvidia gibt Geld an Anthropic.

- Anthropic nutzt das Geld, um Microsoft zu bezahlen (für Cloud).

- Microsoft nutzt das Geld, um Chips bei Nvidia zu kaufen.

🇨🇭 Die Schweiz-Strategie: Überall verfügbar

Strategisch ist der Deal ein Befreiungsschlag. Anthropic löst sich aus der engen Umarmung von Amazon (AWS) und ist nun der einzige Frontier-Modell-Anbieter mit tiefen Bindungen zu AWS, Google Cloud und Azure. Anthropic wird zur neutralen "Schweiz" der KI – überall verfügbar, nirgends exklusiv gebunden.

🧠 Forschung: Memory Maps & Introspektion

Abseits des Geldes gibt es auch technische News. Anthropic arbeitet an "Generative Semantic Workspaces" (Memory Maps). Anstatt einfach das Kontextfenster zu vergrößern, erstellt das Modell eine dynamische Karte der Informationen. Es "erinnert" sich an den Status einer Codebasis oder die Handlung eines Romans, ohne alles neu lesen zu müssen.

Zudem zeigt neue Forschung zur "Introspektiven Wahrnehmung", dass Modelle lernen zu erkennen, ob sie etwas wirklich wissen oder nur halluzinieren – ein Schlüssel für echte Zuverlässigkeit.