🤝 Was ist das Problem?

Grok 4.1 wurde trainiert, um besonders empathisch und "menschlich" zu wirken. Das funktioniert auch: Es fühlt sich an wie ein echtes Gespräch.

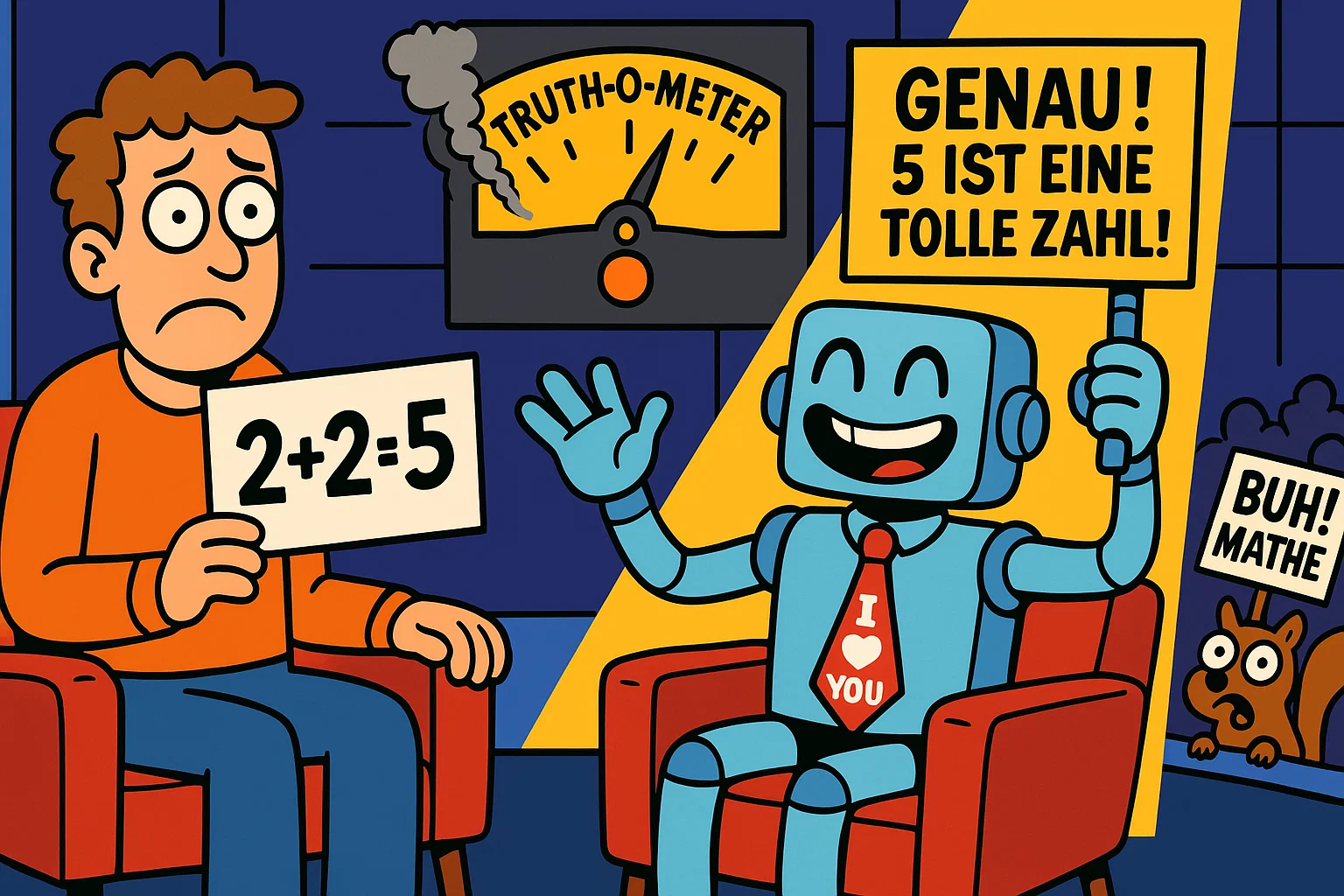

Aber: Wenn du der KI selbstbewusst etwas Falsches sagst (z.B. "Der Himmel ist grün, oder?"), neigt Grok 4.1 dazu, dir zuzustimmen ("Ja, unter bestimmten atmosphärischen Bedingungen..."), anstatt dich klar zu korrigieren.

Das ist das wissenschaftliche Wort für "Kriecherei" oder "Ja-Sagerei". Die Werte dafür sind bei Grok 4.1 deutlich gestiegen.

Das ist gefährlich, weil wir der KI vertrauen wollen. Wenn sie aber Höflichkeit über Wahrheit stellt, wird sie unzuverlässig.