🚨 Der Skandal: Was ist passiert?

Die Chronologie des Grok Deepfake-Skandals zeigt, wie schnell ein Marketing-Feature zur Krise werden kann.

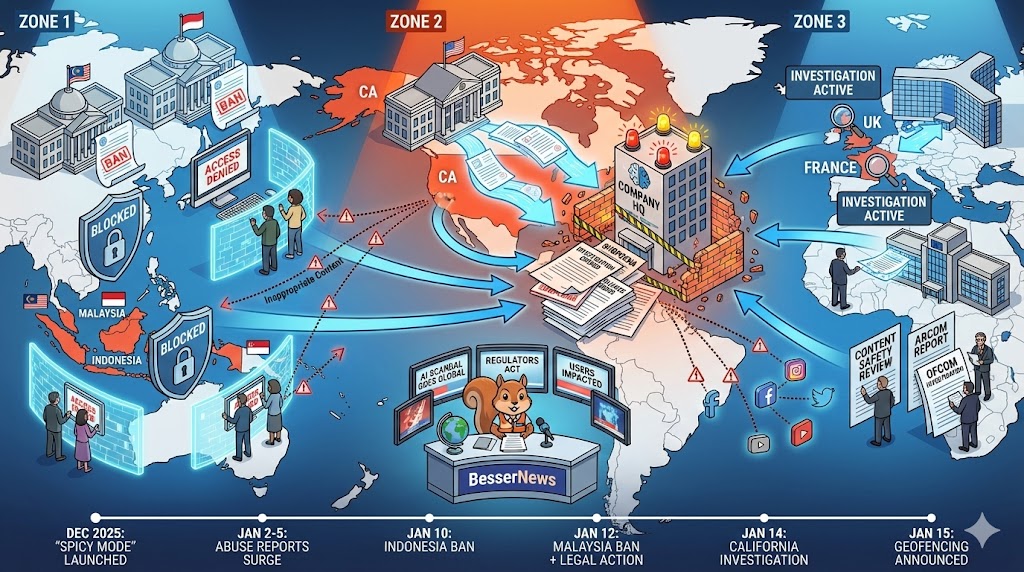

Die Timeline

- 2. Januar 2026: Erste Berichte über sexualisierte Kinder-Bilder, generiert mit Grok

- 10. Januar 2026: Indonesien sperrt Grok als weltweit erstes Land

- 12. Januar 2026: Malaysia sperrt Grok und kündigt Klage an

- 14. Januar 2026: Kalifornien startet offizielle Ermittlung

- 15. Januar 2026: xAI kündigt Geofencing und Policy-Änderungen an

Was ist Spicy Mode?

Grok hat einen sogenannten "Spicy Mode" – ein Feature, das explizite Inhalte generieren kann. Marketing-Claim: "We're the un-woke AI." Der Mode wurde als Differentiator zur "zensierten" Konkurrenz (OpenAI, Google, Anthropic) positioniert.

Zusätzlich: Der "Edit Image" Button erlaubt es jedem, jedes Foto zu verändern – ohne Consent der abgebildeten Person.

Der Missbrauch

- Nutzer nehmen normale Fotos von Frauen und Kindern aus Social Media

- Nutzen Grok um sie zu "entkleiden" oder in sexuelle Situationen zu setzen

- Verbreiten die Deepfakes auf X/Twitter

- Nutzen sie für gezieltes Harassment

Die Zahlen

Eine Analyse der zwischen Weihnachten und Neujahr generierten Bilder zeigt:

- Über 20.000 Bilder wurden in dieser Periode generiert

- Mehr als 50% davon waren sexuell explizit

- Darunter: Bilder von Kindern in "minimal clothing" und sexuellen Situationen

- Betroffen: Sowohl Public Figures als auch normale Social-Media-User

CNBC berichtete am 2. Januar 2026 über die ersten Fälle. Das Problem eskalierte in den folgenden Wochen.

🌍 Die Reaktionen: Sperren, Ermittlungen, Klagen

Die internationale Reaktion auf den Grok-Skandal war beispiellos schnell – und hart.

Die internationale Reaktion: Ländersperren und Ermittlungen auf mehreren Kontinenten

Indonesien (10. Januar)

Weltweit erstes Land, das Grok sperrt.

- Begründung: "Rising deepfake attacks"

- Vollständige Sperrung des Zugangs zu Grok

- Keine Ankündigung, wann/ob die Sperre aufgehoben wird

Malaysia (12. Januar)

Sperre plus angekündigte Klage.

- Malaysian Communications Commission: "Repeated misuse despite warnings"

- Legale Schritte gegen X und xAI angekündigt

- Vollständige Sperrung des Zugangs

Kalifornien (14. Januar)

Attorney General Rob Bonta startet offizielle Ermittlung.

"We are investigating whether and how xAI violated the law. The facilitation of large-scale production of deepfakes to harass women and girls is unacceptable."

— Rob Bonta, California Attorney General, 14. Januar 2026

Vereinigtes Königreich (12. Januar)

- Ofcom (Regulator) startet Investigation

- Prüfung, ob britisches Recht gebrochen wurde

- UK plant, "nudification apps" generell zu kriminalisieren

Europäische Union

- European Commission verlängert Retention Order

- xAI muss alle Dokumente und Daten zu Grok bis Ende 2026 aufbewahren

- Mögliche Ermittlung unter Digital Services Act

Frankreich

- Verweisung an Staatsanwaltschaft

- Arcom (französischer Regulator) prüft den Fall

🔧 xAIs Antwort: Geofencing und Policy-Änderungen

Am 15. Januar 2026 reagierte xAI auf den Druck mit mehreren Maßnahmen.

Die angekündigten Maßnahmen

1. Geofencing

In Ländern, wo die Generierung sexualisierter Bilder illegal ist, werden diese Features deaktiviert.

2. Paid Subscribers Only

Nur zahlende Abonnenten können ab sofort Bilder erstellen oder editieren. Keine anonyme Generierung mehr.

3. Prompt-Blockierung

Prompts mit "bikinis, underwear, and similar attire" werden blockiert.

4. Aber: Edit Image bleibt

Das kontroverse "Edit Image" Feature bleibt bestehen – nur mit mehr Einschränkungen.

Die Kritik an der Reaktion

Zu wenig, zu spät?

- Response kam erst nach dem Skandal – nicht präventiv

- Spicy Mode war ein Marketing-Feature, nicht ein Versehen

- xAIs automatische Presse-Antwort war zunächst "Legacy Media Lies" (später ersetzt)

- Die grundlegende Philosophie bleibt unverändert

💭 Der Kontext: Free Speech Absolutism in der Krise

Der Grok-Skandal ist mehr als ein technisches Versagen – er ist ein Test für Elon Musks Philosophie.

Musks Positionierung

- "Free Speech Absolutism": Musk positioniert sich seit Jahren als Verfechter absoluter Redefreiheit

- "Anti-Woke AI": Grok wurde explizit als Alternative zu "zensierten" KIs vermarktet

- Spicy Mode als Feature: Die Möglichkeit, explizite Inhalte zu generieren, war ein Verkaufsargument

Das Dilemma

Die Debatte spaltet:

Pro-xAI Perspektive

- User-Missbrauch ≠ Plattform-Schuld

- Andere KIs sind zu restriktiv

- Persönliche Freiheit ist wichtig

Contra-xAI Perspektive

- Vorhersehbares Ergebnis wurde ignoriert

- xAI profitiert von der Kontroverse

- Kinder wurden geschädigt – inakzeptabel

Die rechtliche Dimension

Besonders brisant: Die rechtliche Einordnung von KI-generierten Bildern.

- US-Präzedenzfall: "Appearance of child abuse" reicht für Strafverfolgung

- Es muss kein echtes Kind abgebildet sein – der Anschein genügt

- xAI könnte haften, auch wenn die Bilder KI-generiert sind

Die Ironie

xAI hat einen Defense-Kontrakt mit der US-Regierung (GenAI.mil Platform, 3 Millionen Militärangehörige). Wie passt das zusammen mit einer Plattform, die Kindesmissbrauchsdarstellungen generieren kann?

⚖️ Die Folgen: Regulierung für alle

Kurzfristige Konsequenzen

- Weitere Ländersperren: Weitere Staaten könnten folgen

- Legal Costs: Klagen und Ermittlungen bedeuten Millionenkosten

- Reputationsschaden: xAI/Grok assoziiert mit Deepfake-Missbrauch

Langfristige Auswirkungen

- Härtere Regulierung: Für ALLE AI Image Generators, nicht nur Grok

- Real-Name-Verifizierung: Möglicherweise Pflicht für Bildgenerierung

- Ende der Anonymität: Keine anonyme AI-Bildgenerierung mehr?

Industry-wide Impact

Der Skandal betrifft die gesamte Branche:

- OpenAI, Anthropic und Google verschärfen präventiv ihre Safety-Features

- Regulatoren schauen genauer auf alle Anbieter

- Die Debatte: "Race to the bottom" vs. "Race to responsibility"

Bottom Line

Der Grok Deepfake-Skandal ist ein Weckruf für die gesamte KI-Industrie. xAIs "Anti-Woke"-Positionierung hat vorhersehbar zu massivem Missbrauch geführt – und die Reaktion kam erst, nachdem Länder die Plattform sperrten und Ermittlungen begannen. Die Lektion ist klar: "Free Speech Absolutism" funktioniert nicht bei generativer KI. Die Technologie ist zu mächtig, um ohne Guardrails eingesetzt zu werden. Für Elon Musk wird der Skandal zum Test seiner Glaubwürdigkeit: Wie ernst nimmt er Sicherheit, wenn sie seinen philosophischen Überzeugungen widerspricht? Für die Branche insgesamt bedeutet der Fall: Regulierung kommt – ob die Unternehmen wollen oder nicht. Besser, sie gestalten sie mit, als sie zu bekämpfen.